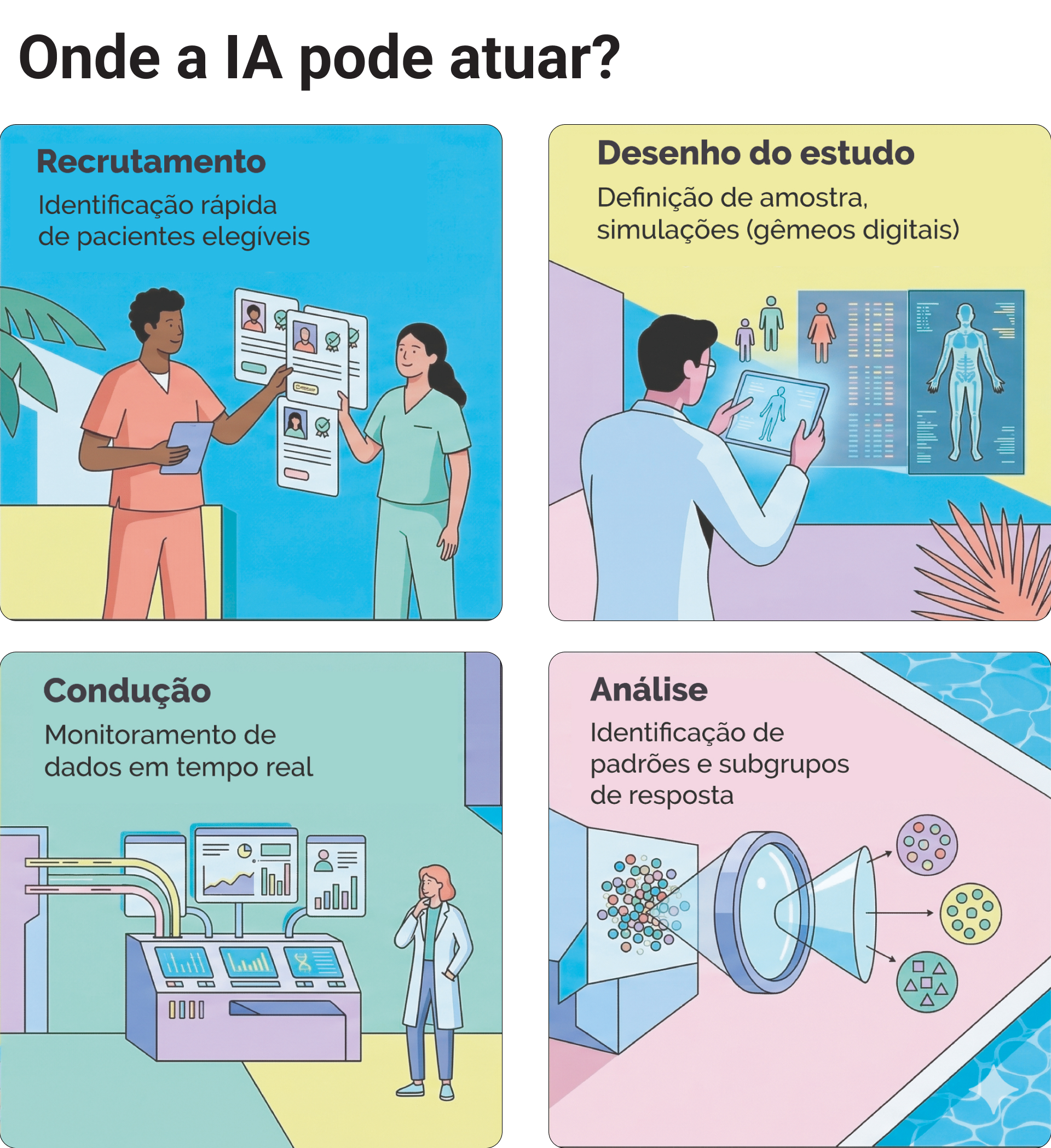

Apesar do entusiasmo, a entrada da IA nos ensaios clínicos não é isenta de riscos. O principal temor reside nos vieses algorítmicos. Como sistemas de IA aprendem com dados do passado, eles podem atuar como espelhos que ampliam preconceitos históricos.

Se uma base de dados usada para treinar um algoritmo for composta majoritariamente por populações de países desenvolvidos, o sistema pode, inadvertidamente, excluir minorias étnicas ou ignorar variações biológicas importantes de outras regiões – o que o algoritmo ‘não vê’, ele acaba por excluir da solução.

Outro obstáculo crítico é a opacidade dos modelos – algo que denominamos ‘algoritmos de caixa-preta’. Muitos sistemas de IA, especialmente, os de aprendizado profundo (deep learning), entregam resultados sem que seus próprios desenvolvedores consigam explicar o caminho lógico percorrido.

Em ciência, a reprodutibilidade – capacidade de outro cientista repetir o experimento e obter o mesmo resultado – é uma regra de ouro. Portanto, a falta de transparência é um sinal de alerta, afinal, como confiar em um medicamento cuja eficácia foi validada por uma lógica que ninguém consegue auditar plenamente?

No campo regulatório, o desafio é igualmente complexo. As diretrizes internacionais que regem os ensaios clínicos, como o Spirit e o Consort, foram desenhadas para um mundo analógico. Embora existam esforços recentes para criar extensões específicas para IA (como o Spirit-AI e o Consort-AI), muitos estudos ainda falham em descrever detalhadamente o papel dos algoritmos.

Essa lacuna dificulta a análise crítica por agências reguladoras, como a Agência Nacional de Vigilância Sanitária (Anvisa), do Brasil, e a Food and Drug Administration (FDA), que regula a aprovação de medicamentos e alimentos nos Estados Unidos.

Por fim, surgem dilemas éticos profundos: se uma decisão automatizada resultar em um erro médico durante o estudo, de quem é a responsabilidade? Do programador, do pesquisador ou da instituição?

A adoção da IA na pesquisa médica não pode ser uma corrida tecnológica desenfreada. Ela precisa ser ancorada em uma governança ética rigorosa e em auditorias independentes que garantam que a tecnologia sirva à ciência – e não o contrário.

A gravidade dessa lacuna regulatória torna-se ainda mais evidente quando observamos a Declaração de Helsinque, o pilar ético global para pesquisas com seres humanos adotado desde 1964 pela Associação Médica Mundial (AMM).

Surpreendentemente, em sua atualização mais recente, em outubro de 2024, o documento permaneceu praticamente silencioso sobre os desafios específicos da era digital. Embora tenha avançado em temas como sustentabilidade ambiental e inclusão de grupos sub-representados, a declaração não oferece diretrizes detalhadas sobre os riscos inerentes à IA, como a privacidade de dados em larga escala, o viés algorítmico e a opacidade do aprendizado de máquina.

Essa omissão deixa um vácuo preocupante: sem uma base ética global que reconheça as particularidades da IA, pesquisadores e comitês de ética ficam desamparados diante de tecnologias que evoluem muito mais rápido do que nossas normas de proteção ao paciente.